生成AIはビジネスシーンにおける活用も一般的になりつつありますが、権利侵害や情報漏洩といったリスクも指摘されています。生成AIの問題点を正しく理解したうえで、リスクを抑えた活用を心がけましょう。

新時代のマーケターとして活躍するための生成AI活用ガイド

マーケティング業務の効率化と成果向上を実現するためのAI活用手法を解説

- 生成AIとは

- マーケター向け生成 AI活用方法

- HubSpot Breeze導入企業活用事例

- HubSpot AI活用でのマーケティング支援

今すぐダウンロードする

全てのフィールドが必須です。

本記事では、生成AIの問題点やビジネス利用で実際に起きた問題の事例を解説します。事前にできる対策も紹介しますので、生成AIの運用方針の策定に活用してください。

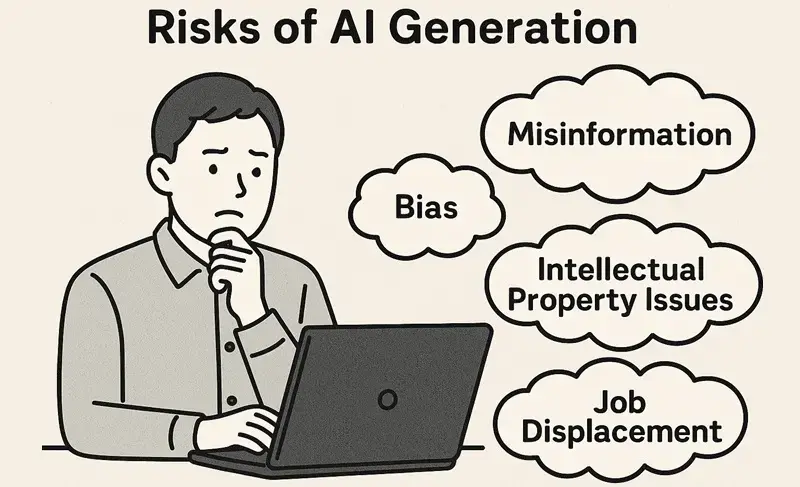

生成AIの利用における問題点

ここでは、生成AIの使用における3つの主な問題点について解説します。

- 権利の侵害

- 情報漏洩

- 虚偽情報の出力

権利の侵害

権利侵害は、生成AIの利用において大きな課題のひとつです。生成AIは、膨大な量のデータを学習し、それをもとに回答を生成しますが、著作権で保護された「著作物」が学習データに含まれていることがあります。

学習に使用されたデータが著作物だった場合、生成された文章や画像などが既存の著作物に似てしまう可能性があり、意図せず著作権侵害となることも考えられます。登録商標や意匠に関しても、既存のものに類似した生成データを使用すると、権利侵害にあたる可能性があります。

生成AIを使用したコンテンツの著作権の考え方については、こちらの記事で詳しく解説していますので、ぜひ参考にしてください。

情報漏洩

生成AIには、情報漏洩のリスクもあります。生成AIに対する「プロンプト」と呼ばれる指示文の中に、機密情報や個人情報が含まれていると、そのデータがAIの学習に利用されることがあります。その結果、意図せず第三者に情報が漏れてしまうリスクが生じます。

また、AIは通常、プライバシーに関わる内容は回答しないように設計されています。しかし、特殊なプロンプトで回答させることによって機密情報を抜き出す「プロンプトインジェクション」と呼ばれるサイバー攻撃があるため注意が必要です。

虚偽情報の出力

AIはあくまでも既存の情報をもとに回答を生成する仕組みになっているため、事実確認を自動で行うことはできません。また、古い情報や誤った情報をもとにコンテンツが生成されてしまうこともあります。

特に注意が必要なのは、AIが「ハルシネーション」と呼ばれる現象を起こす点です。ハルシネーションとは、AIが学習データにもとづいて、もっともらしいが実際には存在しない情報を作り出してしまう現象のことです。

生成AIは文章を生成する際に、統計的に次にくる可能性の高い単語やフレーズをつなぎ合わせます。その際に誤った情報が生成されることが、ハルシネーションの原因のひとつです。

AIが出力した情報をそのまま発信すると、誤った情報が拡散されてしまう危険性もあります。社会的な混乱を招くだけでなく、企業の信頼も損なうことになるので、十分注意が必要です。

生成AIによる問題が発生した事例

ここでは、実際に生成AIのビジネス利用によって問題が発生した事例を3つ紹介します。

- YouTubeの文字起こしをAI学習に使用

- 機密情報の流出

- ディープフェイクによる詐欺

YouTubeの文字起こしをAI学習に使用

複数のグローバルIT企業が、YouTube配信者の承諾を得ずに動画の字幕データを使用していたことが、アメリカのニュースメディアで報じられました。

YouTubeの字幕データは、AIのトレーニングを行うためのデータセットに含まれており、第三者が作成したものでした。当該のデータセットには、YouTubeの字幕データのほか、書籍やWikipediaなどから取得したコンテンツも含まれています。問題となったIT企業は、自社が提供する生成AIサービスの学習データとしてデータセットを使用しました。

IT企業が直接YouTubeの動画から字幕を抜き出したわけではありませんが、配信者の同意を得ずに取得されたデータが使用されたことが問題視されています。

参考:Apple, Nvidia, Anthropic Used Thousands of Swiped YouTube Videos to Train AI

機密情報の流出

グローバル電子機器メーカーのエンジニアが社内機密のソースコードをChatGPTに入力したことで、情報が外部に流出した事例が発生しました。この問題を受けて、同社は従業員に対して、AI搭載のチャットボットの使用を全面的に禁止しました。

入力された情報がAI提供企業のサーバーに保存されて容易に削除できないことや、ほかのユーザーへ機密情報が提供される懸念があることを、生成AIの使用を禁止した主な理由としています。

機密情報の流出は、企業の信用にも関わる問題となっています。

参考:サムスン、ChatGPTの社内使用禁止 機密コードの流出受け | Forbes JAPAN 公式サイト(フォーブス ジャパン)

ディープフェイクによる詐欺

香港の多国籍企業では、会計担当者がディープフェイク技術を用いた詐欺被害に遭いました。ディープフェイクとは、AIで人間の顔や声を精巧に生成する技術のことです。

同社の会計担当者は、最高財務責任者(CFO)や同僚になりすました偽の人物らとのビデオ会議に参加し、指示に従って数十億円を送金してしまいました。

詐欺グループが生成したディープフェイク映像は精巧で、当初は疑念を持っていた被害者も、相手が本物だと信じ込んでしまったという事例です。

これは生成AIが悪用された事例ですが、AIが出力した偽情報に気づかず使用してしまうケースもあり、使用上の問題点となっています。

参考:SNSで拡散 "AI生成の偽の災害画像" ファクトチェックはどうする | NHK

生成AIの問題点に対する対策

ここでは、生成AIの3つの問題点への対策をそれぞれ解説します。

- 権利侵害への対策

- 情報漏洩への対策

- 虚偽情報への対策

権利侵害への対策

生成AIの権利侵害リスクを抑えるためには、著作権に配慮した学習データを使用しているAIサービスを選ぶ方法があります。

例えば、Adobe社の「Firefly」は商用利用を前提に設計されており、著作権上問題のないデータのみをAIの学習に使用しています。

また、生成AIが生成した文章や画像を使用する前に、人間が確認することも大切です。検索エンジンの画像検索機能や文章の類似性をチェックするツールなどを活用しましょう。

情報漏洩への対策

情報漏洩を防ぐには、AIに入力する情報の取り扱い方法を自社で定めたうえで、「機密情報や個人情報をAIに入力しないこと」などを共通ルールにすると良いでしょう。

また、ChatGPTなどのサービスでは、入力されたデータをAI学習に使用しないように設定することが可能です。

ChatGPTの設定は、次の通りです。

ChatGPTの場合は、OpenAIの公式サイトからオプトアウト申請(入力情報を学習させないための申請)もできます。ただし、オプトアウト申請を行うとチャットの履歴が保存されなくなる点に注意が必要です。

虚偽情報への対策

誤情報の拡散を防ぐためには、AI出力内容の精度向上と人間による確認作業が欠かせません。

AIには、実在しない内容をもっともらしく生成してしまう「ハルシネーション」という問題点があります。例えば、AIに商品説明を書かせたところ、実際には存在しないスペックや効果が記載されるといったことがあります。

これを防ぐには、プロンプト(指示文)で具体的な指示を与えることが大切です。生成AIに行って欲しい作業を明確にしたうえで、AIが回答を持たない場合の回答を指定する方法も有効です。具体的には、「提示した情報以外の嘘は書かないでください」「わからないことはわからないと教えてください」といった内容をプロンプトに加えます。

生成されたコンテンツは、一次情報や公式サイトなどを用いて必ず事実確認を行いましょう。

生成AIの問題点を理解し適切に対策しよう

生成AIは非常に便利なツールである一方、権利の侵害や情報漏洩、虚偽情報の出力といったリスクもあります。

著作権に配慮されたAIツールの使用や人間による最終チェックなどを行うことで、リスクを最小限に抑えられます。AIに頼りすぎず、自分自身でリスクを管理する意識を持ちましょう。

HubSpotは、生成AIをコンテンツ制作に活用するための入門ガイドを無料で提供しています。2025年3月時点での生成AIの限界や、生成AIを使ってコンテンツを執筆・編集する際のプロンプトの書き方などがわかる入門ガイドとなっていますので、ぜひダウンロードしてご利用ください。

生成ai